Article

从企业级 CF 平台到云原生(一):架构师的复盘——企业级 CF 平台时代微服务治理的得与失

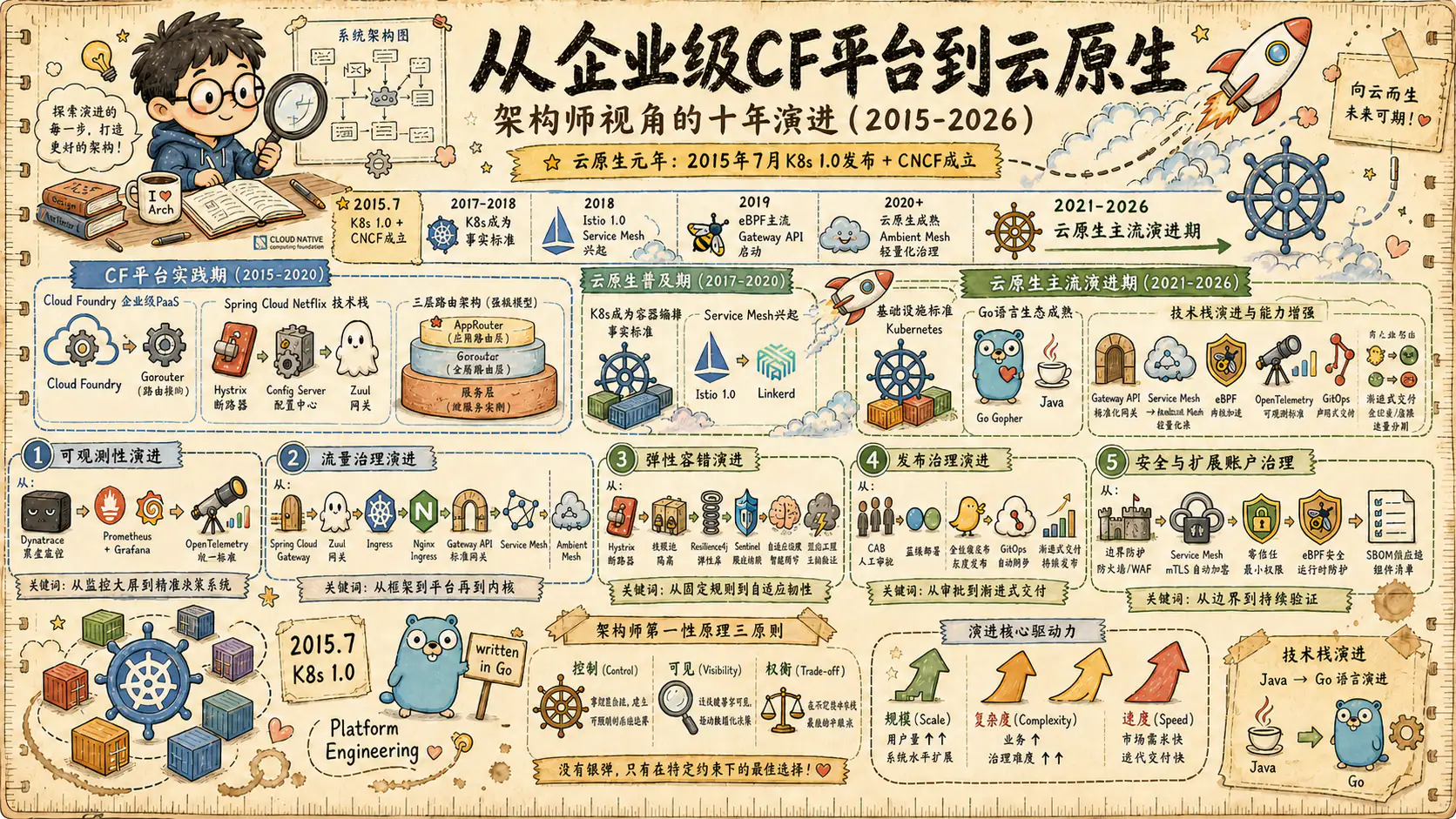

基于 2015-2020 年企业级 CF 平台一线架构实践与 2015-2026(至今)行业观察,复盘 Cloud Foundry 时代的微服务治理设计决策,分析哪些经受住了时间考验,哪些被云原生浪潮重构

从企业级 CF 平台到云原生(一):架构师的复盘——企业级 CF 平台时代微服务治理的得与失

副标题:企业级 CF 平台时代微服务治理的得与失(2015-2020 年,6 年实践)

图 1:通用企业级 Cloud Foundry 平台中的入口路由、身份服务与运行时分层架构

一、开篇定位:六年的 CF 实践与持续行业观察

2015 年春天,企业级 CF 平台正值 Cloud Foundry(CF)在企业级市场快速扩张的时期。彼时,微服务架构刚刚从 Netflix、Amazon 等互联网巨头的技术博客中走入主流视野,Spring Cloud Netflix 套件发布了首个稳定版本,Docker 1.0 发布不到一年,Kubernetes 还处于 0.x 的实验阶段。

本文以 2015-2020 年的企业级 CF 平台一线架构实践为主线,并结合 2015-2026(至今)的持续行业观察来复盘微服务治理的演进。六年间(2015-2020),从单体应用向微服务迁移、数十个服务的拆分、CF 多区域部署架构设计、服务间通信规范制定到可观测性体系建设,这些实践让我对企业级微服务治理形成了系统性理解,也积累了大量关于”什么有效、什么无效”的经验。

从企业级 CF 平台一线实践之后,在不同行业和规模的组织中继续观察架构演进:从初创公司的云原生改造,到金融机构的混合云部署,再到大型电商的 Service Mesh 落地。这些观察提供了跳出企业级 CF 平台特定技术栈的视角,更清晰地看到当年决策中哪些是经得起时间考验的架构原则,哪些是被技术浪潮淘汰的具体实现。

这个系列文章的目标,就是基于 2015-2020 年的企业级 CF 平台实践和持续行业观察,复盘企业级微服务治理的演进历程。本文作为开篇,聚焦 2015-2020 年的企业级 CF 平台时代,回答三个核心问题:

-

当年的技术选型逻辑是什么? 为什么选择 Cloud Foundry + Spring Cloud Netflix 的组合,而不是当时看似更有前景的其他方案?

-

哪些设计原则经受住了时间考验? 六年实践验证下来,哪些决策在今天看来依然是正确的,甚至被后来的技术所继承?

-

哪些决策”当时对,现在局限”? 当年的最优解为什么在今天变成了技术债务?这种转变背后的深层逻辑是什么?

需要说明的是,本文不是对 Cloud Foundry 或 Spring Cloud 的技术文档复述,而是一个实践者的复盘笔记。本文将尽量还原当时的决策场景、权衡因素和后续的实际效果,帮助读者理解企业级技术选型的复杂性,以及如何在技术快速演进的环境中做出可持续的架构决策。

二、企业级 CF 平台时代的治理哲学

2.1 Cloud Foundry 的企业级 PaaS 定位

2015 年前后的 PaaS 市场仍处于早期竞争阶段。Heroku 在公共云领域有先发优势,但主要面向初创公司和小型应用;OpenShift 刚刚起步,容器技术尚未成熟;Google App Engine 的功能限制较多,对 Java 生态的支持也不够完善。在企业级市场,Cloud Foundry 是当时最成熟的选项。企业级 CF 平台选择 CF 作为核心平台,有几个关键考量:

第一,企业级特性完整性。 CF 从设计之初就考虑了多扩展账户隔离、安全合规、审计日志等企业级需求。它的组织(Org)和空间(Space)模型天然适配大型企业的部门结构和权限管理需求。相比之下,早期的 Kubernetes 几乎没有任何多扩展账户安全隔离机制,RBAC 直到 1.6 版本才相对稳定。

第二,与企业级 CF 平台技术栈的契合度。 企业级 CF 平台的核心业务建立在 Java 之上,而 CF 对 Java 应用有最好的支持。Buildpack 机制允许标准化的应用打包, Diego 容器运行时(后来 Garden)提供了与 Docker 兼容但更受控的执行环境。对于需要严格合规审计的企业软件,这种受控环境比自由的容器运行时更合适。

第三,部署模型的简洁性。 cf push 的开发者体验在当时是无与伦比的。开发者只需要关注代码,平台自动处理构建、容器化、调度、负载均衡、日志聚合等底层细节。这种抽象层级对于拥有数千名开发者的企业级 CF 平台来说至关重要——它大幅降低了全公司采用微服务架构的门槛。

cf push 的完整生命周期

cf push 命令背后是一个完整而精密的生命周期管理流程。理解这个流程有助于澄清 Cloud Foundry 与 Kubernetes 在应用部署模型上的本质差异:

图 1-1:cf push 的完整生命周期(平台接管构建、运行时、健康检查与路由注册)

1. Upload(上传)

- CLI 将应用代码压缩并上传到 Cloud Controller

- 生成一个唯一的 app package 存储在 blobstore 中

2. Staging(构建)

- Diego Brain 调度 Staging 任务到 Diego Cell

- Buildpack 检测:根据代码特征(如 pom.xml、package.json)自动选择 buildpack

- 编译打包:

- Java buildpack 下载 JDK、Maven/Gradle

- 执行编译(如

mvn clean package) - 将应用和运行时依赖打包成 Droplet(可执行单元)

- Droplet 存储在 blobstore 中,与代码分离

3. Cell 调度(Diego/Garden)

- Diego Brain 将 Droplet 调度到可用的 Diego Cell

- Garden 容器运行时创建应用容器(类似 Docker 但更受控)

- 下载 Droplet 并解压到容器文件系统

- 设置环境变量、端口、资源限制

4. 应用启动

- 执行 buildpack 生成的启动命令(如

java -jar app.jar) - 健康检查(HTTP/TCP/Process)验证应用就绪

- 应用状态变为 Running

5. 路由注册(Gorouter)

- Cloud Controller 将应用路由(如

my-app.cfapps.io)注册到 Gorouter - Gorouter 更新路由表,将域名映射到容器实例的 IP:Port

- 流量开始转发到应用

这一流程的关键在于平台完全接管了构建和运行时管理——开发者不需要写 Dockerfile,不需要管理镜像仓库,不需要配置调度策略。这种高度抽象在 2015-2020 年间是 CF 的核心竞争力,但也带来了灵活性受限的问题:当需要自定义容器镜像、特权访问、或特定内核参数时,CF 的受控环境就成了约束。

2.2 Spring Cloud Netflix 栈的治理边界

在应用层,企业级 CF 平台选择了 Spring Cloud Netflix 的部分组件作为微服务治理的核心框架。需要特别说明的是,企业级 CF 平台环境并未使用 Eureka 服务注册中心和 Ribbon 客户端负载均衡——服务发现由 Cloud Foundry 的 Gorouter 和内部 DNS 机制处理,这在当时的架构决策中被认为更简洁高效。企业级 CF 平台实际采用的 Spring Cloud Netflix 能力矩阵:

- 熔断降级:Hystrix 实现断路器模式(这是主要使用的治理组件)

- 配置管理:Spring Cloud Config 支持外部化配置

- 未使用:Eureka(服务发现由 CF 平台处理)、Ribbon(负载均衡由 Gorouter 处理)、Zuul(网关由 AppRouter 和 CF Gorouter 处理)

这个选择在今天看来似乎是”跟随主流”,但在 2015-2016 年,它实际上是一个经过深思熟虑的技术决策——只引入必要的治理能力,避免重复造轮子。在企业级 CF 平台当时的大规模团队协作场景下,这个策略显著降低了跨团队技术分歧和运行风险。

这个技术栈的核心设计理念是分层治理:平台层(CF Gorouter)负责服务发现和负载均衡,应用层(Hystrix)负责熔断和容错。这种架构的优势在于职责分离——平台处理通用的网络能力,应用处理特定的业务容错需求。

灵活性优势。 治理逻辑代码化意味着可以精确控制行为。Hystrix 的线程池隔离、超时配置、降级策略都可以通过代码精细调整,而不像后来 Service Mesh 那样依赖外部配置的 DSL。

开发体验优势。 所有治理功能都通过 Spring 的注解和配置机制暴露,Java 开发者可以在不离开熟悉的技术栈的情况下获得完整的微服务能力。

但这个设计也有其隐含的约束:治理逻辑与应用程序紧耦合,升级治理框架意味着必须重新构建和部署应用。在当时,这被视为可以接受的权衡——毕竟,Spring Cloud 的版本迭代相对稳定,而重新部署应用在 CF 上只是几秒钟的事情。

2.3 平台层与应用层的职责划分

企业级 CF 平台架构的一个核心特征是明确的分层治理边界。这个边界可以用”三层路由”模型来概括:

第一层:应用路由器(AppRouter)。这是企业级 CF 平台特定的组件,负责处理用户认证、会话管理、扩展账户路由。在多扩展账户 SaaS 场景中,AppRouter 根据请求的域名或路径确定目标扩展账户,处理 OAuth/OIDC 认证流程,然后将已认证的请求转发给下游服务。

第二层:CF Gorouter。这是 CF 平台的核心路由组件,负责将外部请求映射到具体的应用实例。Gorouter 维护着应用实例的位置映射表,处理 TLS 终止、负载均衡、健康检查。它对应用是完全透明的——应用只需要监听容器内的端口,不需要关心外部的路由配置。

第三层:Cloud Foundry 平台路由与应用层弹性通信。对于平台内部服务间调用,CF 通过内部 DNS(如 apps.internal)支持 container-to-container 通信,配合 network policy 实现服务间安全访问。Gorouter 负责平台级负载均衡。熔断、重试、超时等治理能力由应用层框架(主要是 Hystrix)自行实现,而非 CF 平台自动提供。

这种分层架构的价值在于职责清晰:每一层只处理自己这一层应该处理的问题。AppRouter 不处理服务发现,Gorouter 不处理熔断,Hystrix 不处理外部路由。这种清晰的分层在大型组织中尤为重要——它允许不同团队专注于自己的领域,减少了跨团队协作的复杂性。

2.4 当年的技术选型决策逻辑

回顾当年的技术选型,可以用三个核心原则来概括:

原则一:优先选择经过生产验证的方案。 2015 年的 Netflix 已经在生产环境运行了多年的微服务架构,Spring Cloud Netflix 是对这些实践的系统化封装。相比之下,Istio 要到 2017 年才发布 0.1 版本,Linkerd 1.0 也还在早期阶段。在企业级场景,“有人用过”是一个极其重要的筛选条件。

原则二:控制技术栈复杂度。 当时业界评估过自研服务治理方案的可能性,但最终放弃了。原因不是技术能力问题,而是维护成本问题。一个自研的 RPC 框架、服务发现系统、熔断器,需要专门的团队长期维护。而 Spring Cloud Netflix 有活跃的社区,有 Netflix 的生产背书,有 Spring 生态的完整支持。引入这些组件的成本远低于自建。

原则三:保持与企业级 CF 平台整体技术战略的一致性。 企业级 CF 平台在 2015-2016 年正在大力推广 Cloud Foundry 作为统一的应用平台。选择 CF 原生的机制和 Spring Cloud 的标准方案,意味着可以与公司的平台团队、安全团队、运维团队形成协同。如果选择一个完全不同的技术栈(比如当时已经开始发展的 Kubernetes),会面临大量的组织阻力。

这些决策在当时都是合理的。但从今天的视角来看,其中一些假设在后来发生了变化——这正是下一节要讨论的内容。

2.5 Space 与企业级 CF 平台扩展账户体系的边界:设计时隔离 vs 运行时隔离

结论先行:Space 解决的是交付隔离,扩展账户 解决的是数据与身份隔离;两者不能互相替代。

在 2015-2020 年的企业级 CF 平台实践里,团队内部最容易混淆的概念就是 “CF Space 与 企业级 CF 平台扩展账户体系”。Cloud Foundry 的 Space 天然适合承载 dev/test/prod 等交付流水线分层,但它并不等同于扩展账户安全域。把 Space 当作扩展账户隔离单元,会在规模化后引发资源管理、身份边界和数据生命周期治理的连锁问题。

结合当年企业级多扩展账户落地的一线实践,边界可以归纳为三条:

- Space 是设计时(design-time)隔离单元:主要用于版本、环境、发布流程治理。

- 企业级 CF 平台扩展账户体系是运行时(runtime)隔离单元:用于业务数据隔离、身份隔离、权限隔离。

- 扩展账户 可跨多个 Space 消费应用:运行时扩展账户边界不依赖某个单一 Space。

图 2:Space 与企业级 CF 平台扩展账户体系的治理边界(设计时隔离与运行时隔离)

这个划分的价值,不只是概念清晰,而是直接决定后续治理策略:你会把哪些能力交给平台流程,哪些能力沉淀到扩展账户生命周期服务中。

2.6 扩展账户生命周期治理:Entitlement → Subscription → Onboarding → Runtime → Offboarding

结论先行:多扩展账户治理不是一个静态配置项,而是一条全生命周期流水线。

在企业级 CF 平台时代,扩展账户治理的主线并不是“创建一个扩展账户”这么简单,而是从商业授权到技术退租的闭环链路:

- Entitlement(权限配额):定义客户能使用哪些平台能力与 SaaS 能力。

- Subscription(订阅建立):把某个技术扩展账户与具体应用绑定。

- Onboarding(入驻回调):平台触发回调,应用完成扩展账户级资源初始化。

- Runtime(运行期识别与访问):基于扩展账户上下文执行鉴权、路由和数据访问。

- Offboarding(退租与删除):终止访问、导出窗口、数据删除与审计闭环。

其中有两个在工程实践里非常关键但容易被忽视的点:

- 订阅回调会重复触发,必须做幂等与引用计数:避免重复创建 HDI schema/container 等扩展账户资源。

- 退租逻辑必须和订阅关系绑定:只有最后一个有效订阅结束后,才允许做物理级完全删除。

图 3:多扩展账户生命周期治理流(从授权到退租)

这也是为什么企业级多扩展账户系统最终都会走向“平台回调 + 应用编排 + 审计可追溯”的治理模式:没有生命周期视角,所谓多扩展账户只会停留在“数据库加一列 account_context_id”的初级阶段。

2.7 安全治理链路:AppRouter + OAuth2/OIDC 身份服务(CF 常见实现为 UAA)+ JWT Scope

结论先行:企业级 CF 平台时代的安全治理核心,不是“有没有鉴权”,而是“扩展账户身份是否在全链路中稳定传播并被最小权限消费”。

在运行期链路里,关键步骤是:

- AppRouter 从扩展账户域名/路径识别目标扩展账户;

- OAuth2/OIDC 身份服务(CF 常见实现为 UAA) 在扩展账户 identity zone 下完成认证,并委派到扩展账户 IdP;

- 下发的 JWT 携带 扩展账户、user、scopes;

- 下游微服务基于 JWT 执行扩展账户上下文解析和 scope 校验,再访问扩展账户隔离数据。

这条链路看似标准,但真实工程挑战在于“一致性”:当请求穿越多个微服务、消息通道、异步任务时,扩展账户上下文和权限边界不能丢、不能漂移、不能被默认放大。

图 4:扩展账户安全鉴权链路(身份分区与权限传播)

从今天回看,这套做法依然有长期价值:不管底座是 CF 还是 Kubernetes,扩展账户身份传播、最小权限、审计闭环都是不可替代的治理主线。

三、经受住时间考验的设计原则

六年的企业级 CF 平台实践下来,有些设计决策被证明是经得起时间考验的。它们不是特定技术的特性,而是架构层面的原则,直到今天依然有效。

3.1 三层路由分层思想

前文提到的 AppRouter → Gorouter → Spring Cloud 三层架构,其核心价值不在于使用了什么具体组件,而在于”分层治理”这个原则本身。这个原则包含几个要点:

关注点分离。 每一层只处理特定类型的路由决策。AppRouter 处理扩展账户和认证,Gorouter 处理实例定位,服务层处理业务路由。这种分离使得每一层都可以独立演进——企业级 CF 平台后来在 AppRouter 中引入了更复杂的扩展账户隔离策略,但不需要修改 Gorouter 或服务层。

可替换性。 分层架构允许在不影响其他层的情况下替换某一层的实现。企业级 CF 平台后来将部分产品的 Gorouter 层替换为自定义的入口网关,但 AppRouter 和服务层的代码几乎没有变化。这种可替换性在架构演进时极其宝贵。

故障隔离。 每一层的故障影响范围被限制在该层内。Gorouter 出现问题不会影响服务间的调用,Hystrix 熔断只影响特定服务间的通信。这种故障隔离对于大型分布式系统的稳定性至关重要。

今天,这个原则在 Service Mesh 架构中得到了继承。Istio 的数据平面(Envoy Sidecar)实际上就是在应用层和网络层之间增加了一层治理层,实现了更细粒度的控制和更好的关注点分离。

3.2 蓝绿部署的零停机理念

CF 原生支持的蓝绿部署(Blue-Green Deployment)是另一个经得起时间考验的实践。这个机制允许在不影响线上流量的情况下部署新版本,通过切换路由实现即时回滚。

在企业级 CF 平台的环境中,蓝绿部署解决了几个关键问题:

数据库迁移的协调。 微服务拆分后,数据库 schema 变更是最危险的操作。蓝绿部署允许先部署新版本(绿环境),验证其正常工作后,再执行数据库迁移,最后切换流量。如果迁移失败,可以立即切回蓝环境。

长会话的处理。 企业应用通常有较长的用户会话。直接重启应用会导致会话丢失,影响用户体验。蓝绿部署允许在切换流量前让现有会话在蓝环境自然结束,新会话路由到绿环境。

A/B 测试的基础。 蓝绿部署的路由切换机制可以扩展为按比例分配流量,这为后来的 A/B 测试和金丝雀发布奠定了基础。

今天,蓝绿部署、金丝雀发布、灰度发布已经成为云原生应用的标准实践。Kubernetes 的 Deployment 滚动更新、Flagger 的自动化金丝雀、Argo Rollouts 的渐进式交付,都是这一理念的演进。但在 2015 年前后,CF 已经提供了开箱即用的零停机部署能力,这是其企业级成熟度的重要体现。

3.3 配置与代码分离

Spring Cloud Config 的设计在当时是一个重要进步。它将应用的配置从代码库中剥离,存储在独立的 Git 仓库中,通过 Config Server 在运行时提供给应用。

这个设计解决了几个实际问题:

环境差异化管理。 开发、测试、生产环境的配置差异(数据库连接、API 密钥、功能开关)不再需要在代码中通过条件分支处理,而是通过不同的 Git 分支或 profile 管理。

动态配置更新。 配合 Spring Cloud Bus,配置变更可以推送到运行中的应用,而不需要重新部署。这在紧急调整超时参数、开关功能时非常有用。

审计与合规。 配置的变更历史保存在 Git 中,可以追溯谁在什么时候修改了什么配置。这对于需要通过合规审计的企业软件是必要条件。

今天,配置与代码分离已经成为基本原则。GitOps 模式将这个理念推向了极致——不仅配置,连基础设施定义都纳入 Git 管理。External Secrets Operator、Sealed Secrets 等工具解决了配置安全的问题。但核心原则依然是当年 Spring Cloud Config 所确立的:配置是独立于代码的制品,需要版本控制、审计追踪、动态管理能力。

3.4 可观测性优先的理念转变

企业级 CF 平台环境对可观测性的重视程度在当时是超前的。CF 原生集成了 Loggregator 日志聚合系统,Diego 容器提供详细的应用生命周期事件,Gorouter 记录所有请求的访问日志。在应用层,Spring Boot Actuator 暴露了丰富的健康检查和度量指标。

更重要的是,我们在架构层面确立了”可观测性优先”的设计原则:

每个服务必须暴露健康检查端点。 这不是可选的,而是部署到 CF 的强制要求。CF 的健康检查机制会定期调用 /health,如果返回非 200 状态码,容器会被标记为不健康并重启。

所有请求必须有可追溯的标识。 企业级 CF 平台在应用层实现了早期版本的分布式追踪——每个请求进入系统时被分配一个 correlation ID,这个 ID 随着调用链传播,最终出现在所有相关的日志中。虽然当时还没有成熟的分布式追踪系统(Zipkin 刚开始发展),但这个机制已经让团队能够关联跨服务的日志。

指标必须易于聚合和分析。 所有服务使用统一的格式暴露指标(Micrometer 后来成为标准),通过 Dynatrace 进行收集和分析。企业级 CF 平台在架构评审中明确要求:新功能上线时必须同时定义关键指标(KPI)和告警阈值。

今天,可观测性已经从”运维需求”变成了”架构核心要素”。OpenTelemetry 提供了标准化的观测数据格式,Prometheus 和 Grafana 成为度量数据的事实标准,Jaeger 和 Tempo 处理分布式追踪。但”可观测性优先”的原则——在设计阶段就考虑如何监控、如何排障、如何度量——是当年在企业级 CF 平台就确立的,至今依然有效。

3.5 扩展账户数据隔离的分层策略

结论先行:在企业级多扩展账户 SaaS 场景中,扩展账户数据隔离应默认按“扩展账户独立容器/Schema”优先,按规模与成本再做例外治理。

企业级 CF 平台当年的实践并非“只追求最强隔离”,而是做了分层权衡:

- 默认路径:扩展账户级隔离容器(例如 HDI container per 扩展账户);

- 例外路径:当扩展账户数据量极小且成本约束显著时,才考虑共享存储并配合严格扩展账户列隔离;

- 高合规场景:在恢复、迁移、法务删除、审计追溯要求更高时,优先选择更强隔离单元。

这个决策能够经受时间考验,关键在于它同时满足了四类治理目标:安全边界、运维可操作性、成本可控性、演进可迁移性。

图 5:扩展账户数据隔离决策矩阵(安全、成本与可运维性的平衡)

对今天的架构师来说,这个经验仍然适用:先把“默认隔离等级”定义清楚,再把“降级共享的准入条件”制度化,而不是反过来。

四、那些”当时对,现在局限”的决策

尽管 CF + Spring Cloud Netflix 的架构在当年是合理选择,但技术演进让其中一些决策变成了今天的技术债务。理解这些转变的深层逻辑,比简单地评判”当时选错了”更有价值。

4.1 服务发现:CF 平台路由 vs Kubernetes DNS + Service Mesh

当年的决策场景。

企业级 CF 平台时代,服务发现并非采用 Eureka 等应用层方案,而是依赖 Cloud Foundry 平台原生的 Gorouter 和内部 DNS 机制。这与当时主流的 Spring Cloud Netflix 实践有所不同——企业级 CF 平台选择了”平台提供服务发现,应用专注业务逻辑”的分层架构。

CF 的服务发现机制简洁而高效:应用通过 cf push 部署后,平台自动为其分配内部路由(如 app-name.apps.internal),Gorouter 维护应用实例的位置映射。服务间调用通过内部 DNS 解析到 Gorouter,再由 Gorouter 进行负载均衡。这种方式的优势在于:

- 应用无感知:无需引入 Eureka Client 等库,应用只需要通过 HTTP 调用目标服务的内部域名

- 平台统一维护:服务注册、健康检查、实例上下线都由 CF 平台自动处理

- 多语言友好:无论应用使用 Java、Node.js 还是 Python,服务发现机制完全一致

这种架构决策在当时是有前瞻性的——它预见了后来 Kubernetes Service + DNS 的模式。但 CF 的平台路由也有其局限:主要是 L4 层的负载均衡,不支持基于请求内容的精细路由(如按 header、按权重灰度)。

局限性的显现。

CF 平台路由的第一个局限是功能边界。Gorouter 提供的是基础的轮询负载均衡,不支持以下高级治理能力:

- 细粒度流量策略。 例如按 header/cookie/identity 做路由,或按业务标签做灰度。

- 原生服务间零信任安全。 例如自动 mTLS 证书轮换、细粒度服务授权策略。

- 统一策略下发与回放。 对复杂流量治理策略缺少声明式控制面。

因此,行业后续把更多治理职责继续下沉到 Kubernetes 生态(Service、Gateway API、Service Mesh):

-

标准化需求。 当组织使用多种语言和框架时,为每种语言维护 Eureka Client 的成本很高。基础设施层的方案是语言无关的。

-

运维简化。 Kubernetes 自动处理 Endpoint 的增删,不需要像 Eureka 那样维护独立的高可用集群。

-

能力演进。 Service Mesh 可以提供 Eureka 无法实现的能力,如 mTLS 自动加密、基于权重的灰度路由、丰富的流量指标等。

这不是 Eureka 设计的问题,而是技术环境变化导致的架构模式演进。Eureka 在 2015 年前后仍是很多团队的主流选择;到 2026-03,Kubernetes DNS、Gateway API、Service Mesh 和平台级服务发现已经成为更常见的治理边界。

4.2 配置管理:Spring Cloud Config Server vs GitOps + External Secrets

当年的决策场景。

Spring Cloud Config Server 在当时解决了配置外部化的核心需求。企业级 CF 平台将所有配置集中存储在 Git 仓库中,Config Server 从 Git 拉取配置并暴露为 REST API,应用启动时从 Config Server 获取配置。

这个架构支持配置的多环境管理(通过 Git 分支或 profile)、动态刷新(通过 Spring Cloud Bus)、审计追踪(Git 历史)。在 2015 年,这几乎是唯一成熟的配置外部化方案。

局限性的显现。

Config Server 的第一个问题是单点瓶颈。所有应用的启动都依赖 Config Server,当应用大规模扩容时,Config Server 成为性能瓶颈。虽然可以通过集群化缓解,但这增加了运维复杂度。

第二个问题是安全问题。Config Server 的 REST API 暴露敏感配置,需要额外的认证授权机制。密钥、密码等敏感配置在 Git 中以明文或简单加密存储,不符合现代安全最佳实践。

第三个问题与云原生生态的割裂。Kubernetes 有 ConfigMap 和 Secret 原生机制,Helm 提供了模板化的配置管理,Flux 和 ArgoCD 实现了 GitOps 工作流。Spring Cloud Config 是独立于这些机制的并行系统,无法与 Kubernetes 生态无缝集成。

今天的替代方案。

GitOps 已经成为配置管理的主流范式。配置(包括应用配置和基础设施配置)存储在 Git 仓库中,GitOps 工具(Flux、ArgoCD、Fleet)自动将配置同步到集群。

对于敏感配置,External Secrets Operator 和 Vault 集成提供了安全的密钥管理。配置在 Vault 中存储,应用通过环境变量或挂载卷获取,不需要在 Git 中暴露明文密钥。

Kubernetes 原生的 ConfigMap 和 Secret 配合 downward API、投影卷等机制,提供了灵活的配置注入方式。Helm 和 Kustomize 提供了配置模板化和多环境管理能力。

深层逻辑分析。

从 Config Server 到 GitOps 的转变,反映了配置管理职责的”基础设施化”。Config Server 是应用层的解决方案,配置逻辑耦合在 Spring 生态中;GitOps 是基础设施层的解决方案,配置成为集群状态的一部分。

这种转变的驱动力:

-

统一性需求。 现代应用栈包含 Kubernetes 资源、应用配置、基础设施定义,GitOps 提供了统一的管理平面。

-

安全性提升。 External Secrets 和 Vault 集成解决了 Config Server 时代的密钥管理问题。

-

自动化能力。 GitOps 工具不仅同步配置,还能实现自动回滚、漂移检测、多集群管理等高级功能。

4.3 熔断降级:Hystrix 线程池隔离 vs eBPF + Sidecar-less

当年的决策场景。

Hystrix 是 Netflix 开源的断路器库,提供了熔断、降级、线程池隔离等功能。企业级 CF 平台时代的架构中广泛使用 Hystrix,每个对外部服务的调用都包装在 HystrixCommand 中,配置独立的线程池和超时参数。

线程池隔离是 Hystrix 的核心特性之一。每个依赖服务分配独立的线程池,当某个服务响应变慢时,其线程池会被占满,但不会影响其他服务的调用。这在防止故障扩散方面非常有效。

局限性的显现。

Hystrix 的第一个问题是资源开销。线程池隔离需要为每个依赖维护一组线程,在 Java 中线程是较重的资源。当服务有大量下游依赖时,线程池的总数会很大,增加内存消耗和上下文切换开销。

第二个问题是编程复杂性。开发者需要在代码中显式创建 HystrixCommand,处理各种配置和回调。这种侵入式编程模型增加了代码复杂度,而且与 Java 8+ 的 CompletableFuture、Reactive Streams 等异步编程模式配合不够顺畅。

第三个问题是版本锁定。Hystrix 于 2018 年进入维护模式(Netflix 不再积极开发),Spring Cloud 也在后续版本中移除了对 Hystrix 的默认支持。但在企业级 CF 平台的代码库中,数千个 HystrixCommand 的替换成为巨大的技术债务。

今天的替代方案。

Service Mesh 是熔断降级的主流方案。Istio、Linkerd 等 Service Mesh 在数据平面(Sidecar 或 Proxyless 模式)中实现了熔断功能,对应用完全透明。应用使用普通的 HTTP/gRPC 调用,熔断逻辑由数据平面自动处理。

更前沿的方案是使用 eBPF 实现 Sidecar-less 的服务治理。Cilium、Merbridge 等项目利用 eBPF 在 Linux 内核层实现流量拦截和治理,消除了 Sidecar 的开销,同时提供比 Hystrix 更细粒度的控制能力。

Resilience4j 是 Hystrix 的推荐替代品,提供了类似的熔断功能,但采用更轻量的设计(不依赖线程池隔离,使用信号量或隔板模式)。对于无法使用 Service Mesh 的场景,Resilience4j 是一个较好的过渡方案。

深层逻辑分析。

从 Hystrix 到 Service Mesh 的转变,反映了治理逻辑的”下沉”和”去中心化”。Hystrix 是应用层的库,每个服务独立维护自己的治理逻辑;Service Mesh 是基础设施层的能力,治理逻辑统一在数据平面实现。

这种转变的核心驱动力是关注点分离的深化。在微服务架构中,熔断降级是”横切关注点”——每个服务都需要,但不应该由每个服务的开发者单独实现。Service Mesh 将这个关注点从应用层剥离,下沉到基础设施层,让开发者可以专注于业务逻辑。

eBPF 方案进一步推进了这个趋势,将治理能力下沉到操作系统内核层,获得更高的性能和更低的开销。

4.4 可观测性:Dynatrace 黑盒监控 vs OpenTelemetry 全链路

当年的决策场景。

企业级 CF 平台在 CF 环境中使用 Dynatrace 作为主要APM工具。Dynatrace 是当时企业级 APM 的领导者,提供了自动化的应用拓扑发现、性能基线、异常检测、根因分析等功能。它的一个核心优势是”黑盒监控”——通过注入 Java Agent,自动捕获方法调用、SQL 执行、HTTP 请求,无需修改应用代码。

这种黑盒方式在企业级 CF 平台的大规模环境中非常有价值。数千个服务不需要逐个配置监控埋点,Dynatrace Agent 自动发现服务间的调用关系,构建完整的依赖拓扑图。

局限性的显现。

Dynatrace 的第一个问题是供应商锁定。Dynatrace 的数据格式、查询语言、可视化界面都是专有的,无法与其他工具集成。当企业想使用 Grafana 做统一可视化、使用 Prometheus 做告警时,发现数据导出和转换极其困难。

第二个问题是成本。Dynatrace 按 Agent 数量收费,在大规模微服务环境中,每年的许可费用达到数百万美元。随着服务数量持续增长,这个成本成为预算压力。

第三个问题是标准化。Dynatrace 使用自己的追踪格式,无法与开源的 OpenTracing、OpenCensus 标准兼容。当社区开始形成 OpenTelemetry 标准时,Dynatrace 的支持明显滞后。

今天的替代方案。

OpenTelemetry 已经成为可观测性领域的事实标准。它提供了统一的数据模型和 SDK,支持 traces、metrics、logs 三种观测数据类型。应用接入 OpenTelemetry SDK 后,可以将数据发送到任何兼容的后端(Jaeger、Prometheus、Grafana Tempo、Datadog、Dynatrace 等)。

Prometheus + Grafana 成为度量监控的标准组合。Prometheus 的拉取模型和 PromQL 查询语言被云原生生态广泛接受,Grafana 提供灵活的仪表板和告警能力。

Jaeger 和 Zipkin 处理分布式追踪,Grafana Tempo 和 Loki 提供成本优化的追踪和日志存储方案。

深层逻辑分析。

从 Dynatrace 黑盒监控到 OpenTelemetry 的转变,本质是从”供应商专有方案”到”开源标准方案”的演进。这个转变的驱动力:

-

云原生生态的统一需求。 Kubernetes 生态需要一个与平台无关的观测标准,OpenTelemetry 填补了这个空白。

-

成本优化需求。 开源方案在大规模场景下的成本优势明显,特别是日志和追踪这类数据量巨大的观测类型。

-

可移植性需求。 企业希望避免被单一供应商锁定,OpenTelemetry 的标准格式确保数据可以在不同工具间迁移。

-

开发者体验需求。 OpenTelemetry 提供了更灵活的埋点 API,支持手动和自动埋点,与各种编程语言和框架的集成更顺畅。

值得注意的是,Dynatrace 现在也是 OpenTelemetry 的积极支持者,它的新版产品可以原生接收 OTLP 数据。这验证了标准化的趋势——即使是商业 APM 供应商,也必须拥抱开放标准才能保持竞争力。

4.5 技术演进背后的深层模式

回顾这四个方面的演进,可以总结出一些共同的深层模式:

模式一:从应用层到基础设施层的职责下沉。

服务发现从 CF 平台路由(基础设施层能力)演进到 Kubernetes DNS(基础设施层标准);熔断从 Hystrix(应用层库)下沉到 Service Mesh(基础设施层);配置管理从 Config Server(应用层服务)下沉到 GitOps(基础设施层工具)。

这种下沉的驱动力是关注点分离原则的自然延伸。微服务架构中的治理能力是横切关注点,不应该由每个服务单独实现,而应该由基础设施统一提供。这让应用开发者可以专注于业务逻辑,也让治理能力的演进可以独立于应用程序。

模式二:从库到 Sidecar 再到内核层的能力实现。

服务治理能力的实现方式经历了”应用库 → Sidecar Proxy → eBPF 内核”的演进。每一代方案都试图在”侵入性”和”性能”之间寻找更好的平衡点。

- 应用库(如 Hystrix、Eureka Client):性能好,但侵入性强,多语言支持困难

- Sidecar Proxy(如 Envoy):侵入性低,但增加延迟和资源开销

- eBPF 内核方案:侵入性低,性能接近原生,但依赖较新的内核版本

模式三:从专有方案到开放标准。

观测领域从 Dynatrace 专有格式转向 OpenTelemetry 标准;服务发现领域从 CF 平台路由转向 Kubernetes 标准 DNS;配置管理从 Spring Cloud Config 的 REST API 转向 Kubernetes 标准 ConfigMap/Secret。

这种标准化的驱动力是云原生生态的碎片化——企业使用多种技术栈,需要跨栈的统一标准。开放标准降低了供应商锁定的风险,也促进了工具链的互操作性。

五、从企业级 CF 平台实践视角看今天的治理格局

5.1 2019 年的担忧 vs 2026-03 的现实

2019 年企业级 CF 平台架构进入转型期,业界对 CF + Spring Cloud 架构的未来有一些担忧。到 2026-03 回看,这些担忧有些成真了,有些则被证明是多虑。

| 担忧领域 | 2019 年的预测 | 2026-03 的现实 | 评估 |

|---|---|---|---|

| Kubernetes 主导地位 | K8s 会成为主流,CF 份额会下降 | Kubernetes 继续承担事实上的容器编排底座,Gateway API v1.4 已经 GA 并扩展了入口、路由和角色边界表达 | 预测准确 |

| Service Mesh 普及 | Istio 会成为标准 | Istio 1.29 继续推进 Ambient Mesh 的生产可用性;Linkerd、Cilium 等方案在不同约束下形成补充,Sidecar-less 成为明确分支 | 部分准确 |

| Spring Cloud Netflix 衰退 | Netflix 组件会被替代 | Hystrix 处于维护模式;Spring Cloud Circuit Breaker 的主线实现已经转向 Resilience4j 和 Spring Retry | 预测准确 |

| 多云架构需求 | 企业会要求跨云部署能力 | 多云和混合云成为平台工程常态,企业更关注策略、身份、观测和交付路径的一致性,而不仅是集群抽象一致 | 预测准确 |

| CF 的完全消失 | CF 可能会被彻底淘汰 | CF 思想没有消失,而是以 Cloud Native Buildpacks、内部开发者平台、Golden Path 和 Kubernetes 扩展平台的形式被重新组合 | 预测过于悲观 |

这个对比表反映了技术演进的一个基本规律:范式转变会发生,但旧技术不会立即消失;主流技术会被新标准替代,但企业级场景总有 legacy 系统需要维护。

5.2 Kubernetes 扩展平台:从 PaaS 思想到平台工程

企业级 CF 平台时代留下的关键经验,不是某个产品或项目名称,而是三条平台工程原则:平台托管运行时复杂度、应用团队只暴露业务能力、治理能力通过统一控制面交付。进入 Kubernetes 时代后,这些原则没有消失,而是被重新组合到 Buildpacks、Operator、Gateway API、Service Mesh、OpenTelemetry、GitOps 和内部开发者平台中。

这种转变的核心价值在于桥接:既有应用不必一次性重写为“纯 Kubernetes 原生应用”,平台团队可以先提供标准构建、统一入口、身份接入、遥测采集和发布流水线,再逐步把运行时调度、策略治理和扩展机制迁移到底层 Kubernetes 能力上。

运行时桥接。 Cloud Native Buildpacks 延续了 CF buildpack 的开发者体验:开发者提交代码,平台负责构建镜像、注入运行时依赖并产生可部署制品。与早期 CF 的区别在于,制品形态从受控 droplet 转向标准 OCI image,后续可以进入 Kubernetes、GitOps 和镜像安全扫描链路。

治理桥接。 入口治理从平台路由器逐步转向 Gateway API,东西向治理从应用库和中心化网关转向 Service Mesh 或 sidecarless 数据平面。治理能力仍然由平台统一提供,但表达方式从平台私有配置转向 Kubernetes 标准资源和策略即代码。

观测桥接。 CF 时代的日志、指标和事件系统解决的是“平台能否看见应用”。Kubernetes 时代的 OpenTelemetry、Prometheus、Profiling 和 eBPF 进一步解决“不同运行时、不同语言、不同集群之间能否用同一语义理解系统”。

这个演进揭示的判断是:Cloud Foundry 的平台理念仍然有价值,但实现层必须转向开放标准和可组合控制面。 分层治理、关注点分离、开发者体验优先仍然成立,只是底层运行时从 Diego 转向 Kubernetes,治理层从应用内框架转向 Gateway API、Mesh、Policy 和 OTel 生态。

5.3 企业级 PaaS 的必然趋势

从 CF 到 Kubernetes 平台工程的演进,反映了一个更广泛的行业趋势:企业级 PaaS 不会消失,但会改变形态。

2015 年前后的 PaaS(如 CF)是”围墙花园”——应用必须遵循平台的约束,使用平台提供的运行时和中间件。这种统一性带来了管理的便利,但也限制了灵活性。

2026-03 的 PaaS(基于 Kubernetes 的 platform engineering)是”可组装平台”——平台团队提供标准化能力(通过 CRD、Operator、Policy、Gateway API、OpenTelemetry 和 GitOps 工作流),应用团队在这些约束下保持技术选择的灵活性。Kubernetes 的扩展性让这个模式成为可能。

这个转变的驱动力是开发者生产力的需求。企业需要平台来降低运维复杂性,但开发者不想回到受限的”围墙花园”中。基于 Kubernetes 的 platform engineering 试图在两者之间取得平衡:

- Golden Path:平台团队提供推荐的技术栈和模板,但不强制使用

- Self-Service:开发者可以通过 Portal 或 GitOps 自助获取资源,不需要提交工单

- Guardrails:通过 Policy-as-Code(OPA、Kyverno)实施安全合规约束,而不是依赖人工审批。

越来越多企业正在构建自己的 Internal Developer Platform(IDP)。Backstage、Port、Cortex 等 IDP 工具的兴起,验证了这个趋势:平台的目标不是替开发团队做所有技术选择,而是把安全、交付、观测和合规约束前置为清晰的自助路径。

六、架构师洞察:原则与工具的分离

6.1 微服务治理的本质问题

2015-2026(至今)的行业实践表明,微服务治理的核心问题不是技术选择,而是组织能力和技术复杂度的匹配。

微服务架构引入了分布式系统的所有复杂性:网络分区、最终一致性、级联故障、部署协调。治理工具和平台的作用是控制这些复杂性,让开发团队能够可靠地构建和运行分布式应用。

但这个控制是有成本的。每引入一个治理组件(服务发现、熔断、追踪),就增加了系统的一个故障点和一个需要学习掌握的概念。架构师的工作,是在”治理能力”和”系统复杂度”之间寻找平衡点。

2015 年前后的平衡点是 Cloud Foundry + Spring Cloud Netflix。这个平台提供了足够的治理能力,同时将复杂度控制在可以管理的范围内。对于拥有数千名 Java 开发者的企业级 CF 平台,这是一个合理的选择。

2026-03 的平衡点是 Kubernetes + Gateway API + Service Mesh 或 sidecar-less 数据平面 + OpenTelemetry + GitOps。云平台原生提供了更强大的治理能力,但也引入了更多的概念和组件。架构师需要评估团队的学习能力和运维能力,选择合适的治理层级。

6.2 永恒的设计原则 vs 会被淘汰的实现工具

如何区分”永恒的设计原则”和”会被淘汰的实现工具”?以下是几个判断标准:

永恒的设计原则的特征:

-

与具体技术无关。 分层治理、关注点分离、配置外部化——这些原则不依赖于任何特定工具,在 CF 时代适用,在 Kubernetes 时代同样适用。

-

解决结构性问题。 可观测性优先、故障隔离、零停机部署——这些原则解决的是分布式系统的固有问题,只要构建分布式系统就需要考虑。

-

经受多代技术验证。 分层架构的思想从单体应用到 SOA 再到微服务一直在使用;熔断模式从 Hystrix 到 Service Mesh 保持了核心逻辑不变。

会被淘汰的实现工具的特征:

-

与特定运行时紧耦合。 Hystrix 的线程池模型与 Java 的线程模型绑定,不适应协程/异步模型。

-

供应商或社区支持减弱。 Hystrix 进入维护模式,Spring Cloud Netflix 被标记为废弃;Dynatrace 虽然仍在发展,但其专有格式被开放标准挤压。

-

被标准化方案替代。 Config Server 的 REST API 被 Kubernetes 的 ConfigMap/Secret 标准替代;Eureka 的注册协议被 Kubernetes DNS 标准替代。

6.3 给架构师的实用建议

基于 2015-2026(至今)的行业经验,给正在做技术选型的架构师几条建议:

建议一:优先选择标准化方案。

当面临技术选择时,优先考虑符合行业标准、社区活跃的方案。专有方案可能在某些方面有优势,但长期看标准化方案的可维护性和人才可得性更好。OpenTelemetry 正在替代各种专有 APM,Prometheus 成为度量标准,Kubernetes 成为容器编排标准——这些趋势应该影响你的选型决策。

建议二:控制技术栈的广度。

微服务治理涉及很多领域:服务发现、负载均衡、熔断、限流、认证、授权、追踪、度量、日志。不要试图在每个领域都选择”最佳”工具,这会导致技术栈过于复杂。相反,选择一套集成良好的组合(如 Kubernetes + Istio + Prometheus + Grafana + Jaeger),接受其中的权衡。

建议三:为迁移预留空间。

技术会演进,今天的最佳选择可能五年后需要替换。架构设计时应该考虑可迁移性:避免与特定工具的深度耦合,使用抽象层封装外部依赖,保持领域逻辑的独立。这样当需要更换服务发现或熔断方案时,影响范围可以控制在边界层。

建议四:投资平台工程能力。

无论是使用 Cloud Foundry、Kubernetes,还是自研平台,企业级微服务治理都需要专门的”平台工程”团队。这个团队负责维护治理基础设施、制定最佳实践、提供开发者支持。将平台视为产品,为内部开发者提供良好的用户体验(文档、工具、自动化),这比选择什么具体技术更重要。

七、结语:技术演进的辩证视角

回顾 2015-2020 年的企业级 CF 平台实践,既有对当年决策的肯定,也有对技术演进的感慨。

肯定的是,当年的架构师在信息不完备的情况下做出了合理的选择。Cloud Foundry 是当时最成熟的企业级 PaaS,Spring Cloud Netflix 是对 Netflix 生产实践的可靠封装,三层路由架构清晰分离了关注点。这些决策支撑了企业级 CF 平台核心产品的微服务化转型,为后来的云原生演进奠定了基础。

感慨的是,技术演进的速度和深度超出了当年的预期。Kubernetes 从 0.x 实验项目成长为云原生生态的基石,Service Mesh 从概念变成生产标配,eBPF 从内核特性变成基础设施创新的平台。当年看似先进的方案,在今天的视角下有了明显的局限。

但这种感慨不应该变成对过去的否定。技术选型永远是特定时间点的最优解,而不是永恒真理。架构师的责任不是预测未来,而是在当前约束下做出可持续的决策,同时为未来的演进预留空间。

这个系列文章的下一篇,将讨论可观测性如何从监控大屏演进为治理决策系统。后续文章会继续沿着流量治理、弹性容错、发布治理和架构师视角总结展开,帮助读者把 2015-2020 年的 CF 实践与 2026-03 的云原生治理格局串联起来。

关于作者

milome,十余年企业级架构设计经验,曾任职企业级 CF 平台高级架构师,主导过多个大型微服务平台的架构设计与落地。目前专注于云原生技术架构与治理体系的研究与实践。

系列文章预告:

- 第二篇:可观测性驱动治理——从监控大屏到精准决策系统

- 第三篇:流量治理的演进——从 Spring Cloud Gateway 到 Gateway API 与 Ambient Mesh

- 第四篇:弹性容错的重新定义——从 Hystrix 到自适应治理

- 第五篇:发布治理的进化——从人工审批到渐进式交付

- 第六篇:总结——企业级微服务治理的架构师视角

参考与延伸阅读

- Cloud Foundry 官方文档:https://docs.cloudfoundry.org/

- Spring Cloud Netflix 文档(已归档):https://spring.io/projects/spring-cloud-netflix

- Netflix Hystrix 项目状态:https://github.com/Netflix/Hystrix

- Spring Cloud Circuit Breaker 文档:https://spring.io/projects/spring-cloud-circuitbreaker

- Gateway API 项目文档:https://gateway-api.sigs.k8s.io/

- Gateway API v1.4 发布说明:https://kubernetes.io/blog/2025/11/06/gateway-api-v1-4/

- Istio 1.29 发布说明:https://istio.io/latest/news/releases/1.29.x/announcing-1.29/

- OpenTelemetry Specification Status:https://opentelemetry.io/docs/specs/status/

- Cilium Service Mesh 文档:https://docs.cilium.io/en/stable/network/servicemesh/

- Cloud Native Buildpacks 文档:https://buildpacks.io/docs/

- Backstage 文档:https://backstage.io/docs/

- CNCF Cloud Native Landscape:https://landscape.cncf.io/

- Martin Fowler - Microservices Resource Guide:https://martinfowler.com/microservices/

- Brendan Burns - Designing Distributed Systems(O’Reilly, 2018)

本文基于作者在企业级微服务治理领域的亲身实践撰写,所有技术观点仅代表个人经验和观察,不构成任何产品或技术的官方评价。

Series context

你正在阅读:从企业级 CF 平台到云原生:企业级微服务治理的十余年演进

当前为第 1 / 6 篇。阅读进度只写入此浏览器的 localStorage,用于回到系列页时定位继续阅读入口。

Series Path

当前系列章节

点击章节会在此浏览器记录本地阅读进度;刷新后可继续阅读。

- 从企业级 CF 平台到云原生(一):架构师的复盘——企业级 CF 平台时代微服务治理的得与失 基于 2015-2020 年企业级 CF 平台一线架构实践与 2015-2026(至今)行业观察,复盘 Cloud Foundry 时代的微服务治理设计决策,分析哪些经受住了时间考验,哪些被云原生浪潮重构

- 从企业级 CF 平台到云原生(二):可观测性驱动治理——从监控大屏到精准决策系统 以 6 年企业级平台架构师实战经验,剖析可观测性在微服务治理中的核心地位,从数据孤岛到 OpenTelemetry 统一标准,构建精准决策的治理体系

- 从企业级 CF 平台到云原生(三):流量治理的演进——从 Spring Cloud Gateway 到 Gateway API 与 Ambient Mesh 回顾 Spring Cloud Gateway 在企业级 CF 平台的实践,剖析 Kubernetes Gateway API 的标准化价值,探索 Service Mesh 到 Ambient Mesh 的演进逻辑,为企业流量治理选型提供决策框架。

- 从企业级 CF 平台到云原生(四):弹性容错的重新定义——从 Hystrix 到自适应治理 回顾 Hystrix 在微服务弹性治理中的历史地位,剖析 Resilience4j 的轻量设计哲学,探索自适应容错和混沌工程的新范式,为企业构建韧性系统提供实践指南。

- 从企业级 CF 平台到云原生(五):发布治理的进化——从人工审批到渐进式交付 回顾传统发布治理的人工审批模式,剖析蓝绿部署与金丝雀发布的演进,探索 GitOps 和渐进式交付的新范式,为企业构建高效安全的发布体系提供实践指南。

- 从企业级 CF 平台到云原生(六):总结——企业级微服务治理的架构师视角 回顾 2015-2026(至今)微服务治理十余年演进脉络,提炼架构师的第一性原理,总结企业级治理的落地路径与常见陷阱,展望未来趋势,为技术决策者提供系统性思考框架。

Reading path

继续沿这条专题路径阅读

按推荐顺序继续阅读 微服务治理 相关内容,而不是只看同专题的随机文章。

Next step

继续深入这个专题

如果这篇内容对你有帮助,下一步可以回到专题页继续系统阅读,或者订阅后续更新。

正在加载评论...

评论与讨论

使用 GitHub 账号登录参与讨论,评论将同步至 GitHub Discussions